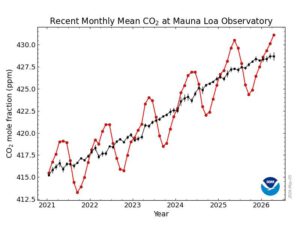

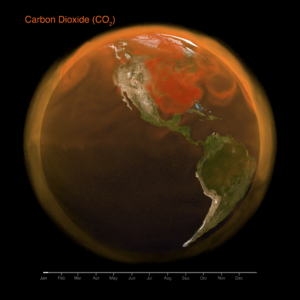

Die Kohlendioxidwerte in der Atmosphäre haben gerade einen ‚deprimierenden‘ neuen Rekord erreicht

Diese Daten stammen vom Mauna Loa Observatory der National Oceanic and Atmospheric Administration, das bald wegen

geplanter staatlicher Haushaltskürzungen geschlossen werden könnte. Die Menge an Kohlendioxid in der Atmosphäre

erreichte im April einen Rekordhoch CO2 .Die Werte lagen in diesem Monat laut Daten, die am Mauna Loa Observatory

der National Oceanic and Atmospheric Administration in Hawaii gesammelt wurden, im Durchschnitt etwa 431 Teile

pro Million (ppm). Treibhausgase wie Kohlendioxid werden als Anteil an der gesamten Atmosphäre gemessen.

Die Zahlen werden als die Anzahl der Moleküle eines bestimmten Gases aus einer Gesamtmillion Molekülen,

also ppm, dargestellt.

Der Klimawissenschaftler Zachary Labe von Climate Central, einer gemeinnützigen Organisation zur Erforschung des Klimawandels, sagt, der neue Rekord sei „deprimierend“, aber nicht unerwartet. „Es ist nur ein weiteres Zeichen dafür, dass Kohlendioxid in unserer Atmosphäre weiter zunimmt, während unser Planet sich erwärmt“, sagt er. „Für viele Klimawissenschaftler ist das einfach ‚hier ist es wieder, ein weiterer Rekord in die falsche Richtung.'“

Labe erklärt, dass die Menge von CO2 in der Atmosphäre erreicht die Atmosphäre jedes Jahr im April ihren Höhepunkt, wenn verrottende Pflanzen nach dem Winter Treibhausgase freisetzen. Ein Teil dieses CO2 wird von Pflanzen während des Wachsens in den wärmeren Monaten wieder aufgenommen. Aber die Daten der NOAA zeigen einen besorgniserregenden Trend, mit der durchschnittlichen monatlichen Menge an CO2 es nimmt stetig zu.

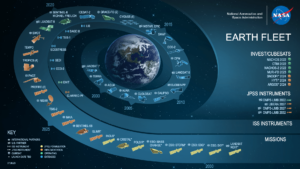

Das Mauna Loa Observatorium beobachtet direkt atmosphärische CO2 und führte seine Werte am längsten von allen anderen US-Einrichtungen auf. Mauna Loa begann erstmals 1958, die Präsenz des Gases in der Atmosphäre zu verfolgen. In jenem Jahr war das April-Level von CO2 unter 320 ppm.

Der Rekord kommt zu einer Zeit, in der das Observatorium Gefahr läuft, seine Finanzierung zu kürzen. Ein Haushaltsvorschlag auf der Website der NOAA für das Haushaltsjahr 2027, der im Oktober 2026 beginnt, schlägt vor, die Mittel für zahlreiche Klimaüberwachungseinrichtungen, darunter Mauna Loa, zu kürzen.

Andere Methoden können die Kohlenstoffwerte in der Atmosphäre weiter zurückverfolgen. Zum Beispiel können Klimatologen kleine Gasblasen analysieren, die in Eiskernen eingeschlossen sind, um die Erdatmosphäre vor Hunderttausenden von Jahren zu untersuchen. Auf ihrer Website zitiert NOAA Analysen, die zeigen, dass in der Zeit vor der industriellen Revolution die atmosphärische CO bei 280 ppm oder weniger lag. Selbst während der Zwischenglazialzeiten, als die Erde zu wärmeren Temperaturen und höheren CO-Werten tendierte, schien die Gasmenge in der Atmosphäre bei etwa 300 ppm gewachsen zu sein.

Dennoch sagt Labe, dass es Gründe für Optimismus gibt, da die Nutzung erneuerbarer Energiequellen wie Solar- und Windenergie zunimmt.

Mit dem Aufstieg privater orbitaler Lebensräume wird der Urlaub

im All für die Ultrareichen zu einer realen Möglichkeit

Der erste Schritt der Astronauten an Bord kommerzieller Raumstationen –

das Erlebnis wird anders sein als alles, was sie bisher erlebt haben.

Sie fanden Holzvertäfelungen und warme Innenräume, Schlafpods der

nächsten Generation, große Fenster für einen atemberaubenden Blick auf die

Erde und eine Atmosphäre, die der eines gehobenen Hotels am Boden ähnelte.

Diese Vision ist das Versprechen mehrerer privater Bemühungen, in den kommenden

Jahren orbitale Lebensräume zu starten, die sowohl Weltraumtouristen als auch

Regierungsastronauten willkommen heißen könnten.

Die erste von vier geplanten kommerziellen Raumstationen, Haven-1 vom in Kalifornien

ansässigen Unternehmen Vast, soll Anfang 2027 starten. Diese Außenposten werden entwickelt,

einige mit Finanzierung von der NASA, als Nachfolger der ISS vor deren geplanter

Außerdienststellung in den 2030er Jahren. Der Wechsel von öffentlichen zu privaten

Raumstationen, eine Premiere in der Menschheitsgeschichte, bringt neue Möglichkeiten mit sich,

das Leben im Orbit neu zu denken.

Es wird ein futuristisches Erlebnis“, sagt Dylan Taylor, CEO und Vorsitzender von Voyager

Technologies in Colorado, dem Unternehmen, das die Entwicklung der Starlab-Raumstation

leitet und für 2029 gestartet werden soll. „Statt ‚Luxus‘ ist ‚modern‘ oder ‚fortschrittlich‘

ein besseres Wort“, sagt er und weist darauf hin, dass die ISS – obwohl großartig – auf der

Technologie der 1980er und 1990er Jahre basierte. „Alles, was wir bauen, ist Technologie der

2020er oder 2030er Jahre.

„Alle Stationen sind dafür vorgesehen, in einer Höhe ähnlich der der ISS, etwa 250 Meilen

über der Erde, zu orbitieren und Besatzungen von jeweils vier bis zehn Personen zu

unterstützen.

SpaceX‘ Crew Dragon-Kapsel oder vielleicht andere Fahrzeuge, wie Boeings.

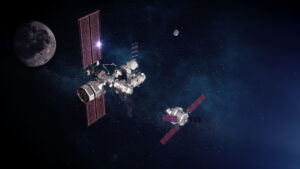

Von den vier Unternehmen, die an solchen Projekten beteiligt sind, könnte Vast

am nächsten an der Einführung eines Weltraumhabitats stehen. Zwei weitere

Konkurrenten, Axiom Space der Axiom Station in Texas und Orbital Reef, angeführt

von Blue Origin im Bundesstaat Washington, haben ebenfalls angekündigt, bis

Ende des Jahrzehnts zu starten. Jeder der Sender muss einer werden wahrscheinlich

den Großteil des Transports übernehmen. Die Aufenthalte an Bord der

Stationen dauern zunächst Wochen, könnten aber auf Monate oder sogar Jahre

verlängert werden.

Alle Stationen sind dafür vorgesehen, in einer Höhe ähnlich der der ISS, etwa 250

Meilen über der Erde, zu orbitieren und Besatzungen von jeweils vier bis zehn Personen

zu unterstützen. SpaceX‘ Crew Dragon-Kapsel oder vielleicht andere Fahrzeuge, wie

Boeings angeschlagener Starliner, werden wahrscheinlich den Großteil des Transports

übernehmen. Die Aufenthalte an Bord der Stationen dauern zunächst Wochen, könnten aber

auf Monate oder sogar Jahre verlängert werden.

Die Weltraumtoiletten auf der [ISS] haben häufig Probleme. Es ist, als würde

man auf einem Staubsauger sitzen. Es ist keineswegs luxuriös.“ —Jeff Nosanov,

ehemaliger NASA-Proposal Manager. Erwartete Gäste sind Weltraumtouristen,

private Forscher und staatliche Astronauten.

Roman Chiporukha, Mitbegründer des in New York ansässigen Unternehmens SpaceVIP,

das Tickets ins All vermittelt, sagt, die Stationsbetreiber prüfen „still und leise das Interesse“,

um herauszufinden, wie viele Reisende sie erwarten könnten. Mit Ticketpreisen für einen

Aufenthalt von fast 100 Millionen Dollar ist die potenzielle Kundenbasis wahrscheinlich

nicht groß. „Es gibt vielleicht 1.000 Menschen auf der Welt, die sich das leisten können“,

sagt Chiporukha.

Taylor erwartet, dass die Besucher zumindest anfangs „meist“ staatlich geförderte professionelle

Astronauten von Agenturen wie der NASA sind. An Bord werden sie in der Lage sein, ein breites

Spektrum an Forschung durchzuführen oder ein, um bei der Konzeption seiner Station zu helfen.

Haven-1 wird ein sauberes und elegantes Interieur mit Holzvertäfelungen und weichen Oberflächen

bieten; Werbebilder zeigen Besucher, die unter einer gemütlichen, aufblasbaren Bettdecke schlafen,

die Druck ausübt, damit es sich anfühlt, als stünden sie unter dem Einfluss der Schwerkraft.

„Es soll auf jeden Fall eher ein Luxuserlebnis sein“, sagt Chiporukha. Axiom hingegen engagierte

den französischen Designer Philippe Starck für das Interieur seines Bahnhofs, das blasenartige

gepolsterte Wände für komfortable Wohnräume umfasst.

Das liegt an der potenziell störenden Wirkung, alle 24 Stunden 15 oder 16 Sonnenuntergänge

und Sonnenaufgänge zu sehen. „Wenn man an luxuriöse Erlebnisse denkt, möchte man sicherstellen,

dass sich die Leute wohlfühlen“, sagt sie. „Schlafqualität ist etwas, worüber Astronauten sehr

offen sprechen.“ Optionen zur Verbesserung des Schlafens im Orbit umfassen die Verwendung

kontrollierter Beleuchtung innerhalb der Station, um einen Sonnenaufgang und Sonnenuntergang

zu Beginn und Ende des traditionellen Tages zu simulieren und so eine gewisse Wahrnehmung

eines täglichen Zyklus aufrechtzuerhalten.Es gibt auch das Problem, die Stationen tatsächlich zu

betreiben und zu warten, was Crews von engagierten Astronauten, nicht nur Weltraumtouristen,

erfordern wird, um sicherzustellen, dass rund um die Uhr alles reibungslos funktioniert.

„Fast die gesamte Zeit, die Astronauten auf der ISS verbringen, dient dazu, sie am Laufen zu halten“,

sagt Nosanov. Die neuen Stationen werden „anfangs wirklich sauber sein, aber das wird nicht lange

halten. Ich meine, eine Raumstation riecht die ganze Zeit nach Furzen. Und die Leute baden nicht –

sie waschen sich ein wenig, aber es ist wirklich Überlebensleben.“

Schlaf wird ein entscheidender Bestandteil sein, um kommerzielle Raumstationen heimelig wirken zu

lassen, sagt Anastasia Prosina, Gründerin der Raumfahrtberatung Stellar Amenities und Beraterin

für die Entwicklung von kommerziellen Weltraumhabitaten mit Sitz in Kalifornien. Das liegt an der

potenziell störenden Wirkung, alle 24 Stunden 15 oder 16 Sonnenuntergänge und Sonnenaufgänge

zu sehen. „Wenn man an luxuriöse Erlebnisse denkt, möchte man sicherstellen, dass sich die Leute

wohlfühlen“, sagt sie. „Schlafqualität ist etwas, worüber Astronauten sehr offen sprechen.

“ Optionen zur Verbesserung des Schlafens im Orbit umfassen die Verwendung kontrollierter

Beleuchtung innerhalb der Station, um einen Sonnenaufgang und Sonnenuntergang zu Beginn

und Ende des traditionellen Tages zu simulieren und so eine gewisse Wahrnehmung eines täglichen

Zyklus aufrechtzuerhalten.

Selbst mit allen guten Absichten gibt es einige Aspekte des Lebens in einem begrenzten Raum im Orbit,

die vorerst nicht luxuriös gemacht werden können. Toiletten zum Beispiel sind berüchtigt schwer

mit irgendeinem Maß an Glamour zu gestalten. „Die Weltraumtoiletten auf der [ISS] haben häufig

Probleme“, sagt Nosanov. „Es ist, als würde man auf einem Staubsauger sitzen. Es ist keineswegs

luxuriös.“

Es gibt auch das Problem, die Stationen tatsächlich zu betreiben und zu warten, was Crews von

engagierten Astronauten, nicht nur Weltraumtouristen, erfordern wird, um sicherzustellen, dass

rund um die Uhr alles reibungslos funktioniert. „Fast die gesamte Zeit, die Astronauten auf der

ISS verbringen, dient dazu, sie am Laufen zu halten“, sagt Nosanov. Die neuen Stationen werden

„anfangs wirklich sauber sein, aber das wird nicht lange halten. Ich meine, eine Raumstation

riecht die ganze Zeit nach Furzen. Und die Leute baden nicht – sie waschen sich ein wenig,

aber es ist wirklich Überlebensleben.“

Dennoch sind diese Stationen vielleicht der erste Schritt zu einer Zukunft luxuriöserer

Wohnräume –vielleicht mit der perfekten Raumtoilette obendrein.

Was ist Mythos, das unveröffentlichte KI-Modell von Anthropic, und wie besorgt sollten wir uns machen?

Statt einer öffentlichen Einführung nutzt Anthropic seine Project Glasswing-Initiative, um einer kleinen Gruppe von Organisationen Zugang zu seinem Mythos-KI-Modell für Cybersecurity-Tests zu ermöglichen.

Das Unternehmen sagt, Mythos sei zu gefährlich, um es öffentlich zu veröffentlichen. Cybersicherheitsexperten sind sich einig, dass die Fähigkeiten des Modells wichtig sind, aber nicht alle glauben an alle alarmierenden Behauptungen.

Im Anschluss an Anthropics Ankündigung seines neuesten künstlichen Intelligenzmodells Mythos am 7. April stand das Unternehmen an einer ungewöhnlichen Entscheidung fest: Es weigerte sich, es der Öffentlichkeit zugänglich zu machen. Seit OpenAI 2019 sein GPT-2-Modell vorübergehend zurückgehalten hat, hat kein großer Entwickler ein System als zu gefährlich für die Öffentlichkeit eingestuft. Mehr als eine Woche später hallt diese Entscheidung immer noch in Finanz- und Regulierungskreisen wider.

Ein 245-seitiges technisches Dokument, das zusammen mit der Ankündigung veröffentlicht wurde, beschreibt, was das Unternehmen als großen Leistungssprung darstellt. Das Modell funktioniert wie ein leitender Softwareentwickler und zeigt die Fähigkeit, subtile Fehler zu erkennen und Fehler selbst zu korrigieren. Es erzielte außerdem 31 Prozentpunkte mehr als Anthropics bisheriges Spitzenmodell, Opus 4.6, bei der USAMO 2026 Mathematical Olympiad, einem anspruchsvollen, zweitägigen, auf Beweis basierenden Wettbewerb. Statt einer öffentlichen Einführung beschränkt Anthropic den Zugang auf eine Reihe von Organisationen, die defensiv genutzt werden können, sodass sie ihre Netzwerke scannen und Probleme beheben können, bevor die Mängel öffentlich bekannt werden. Diese Initiative heißt och genau diese Programmierkompetenz macht Mythos zu einer beeindruckenden offensiven Waffe, und Anthropic sagt, es könne alle außer den erfahrensten Menschen darin übertreffen, Softwareschwachstellen zu erkennen und auszunutzen. In Tests wurden kritische Fehler in jedem weit verbreiteten Betriebssystem und Webbrowser festgestellt. Von diesen Verletzlichkeiten, . Zur ursprünglichen Gruppe gehören Microsoft, Google, Apple, Amazon Web Services, JPMorgan Chase und Nvidia.

Mythos ist das erste einer neuen Reihe von KI-Modellen, die auf Grafikprozessoren der nächsten Generation (GPUs) trainiert wurden – den fortschrittlichen Chips, die das KI-Training antreiben – und seine Fähigkeiten haben Finanzunternehmen weit über die erste Ankündigung hinaus beunruhigt: Am Donnerstag Statt einer öffentlichen Einführung beschränkt Anthropic den Zugang auf eine Reihe von Organisationen, die defensiv genutzt werden können, sodass sie ihre Netzwerke scannen und Probleme beheben können, bevor die Mängel öffentlich bekannt werden. Diese Initiative nennt man , sie würden Behörden und Cyber-Experten zu den Risiken konsultieren, während Projekt Glasswing, dass die KI-Risikotests nach dem Erscheinen von Mythos verstärkt wurden.Ciaran Martin, Professor für Praxis an der Blavatnik School of Government der Universität Oxford und ehemaliger CEO des National Cyber Security Center im Vereinigten Königreich, teilt diese Ansicht. „Es ist eine große Sache, aber es wird wohl nicht das Ende der Welt sein“, sagt er. „Ich wäre nicht am apokalyptischeren Ende der Skala.“

Dennoch bleibt die Cybersicherheitsgemeinschaft uneinig über das wahre Ausmaß der Bedrohung. „Die Ankündigung von Anthropic war sehr dramatisch und zumindest ein PR-Erfolg“, sagt Peter Swire, Professor an der School of Cybersecurity and Privacy am Georgia Institute of Technology und ehemaliger Berater der Clinton- und Obama-Regierungen. Swire stellt fest, dass unter seinen Kollegen „ein großer Teil der Cybersicherheitsprofessoren glaubt, dass dies im Grunde das ist, was erwartet wurde, und im Grunde mehr vom Gleichen.

AISI räumte Grenzen der Fähigkeiten der KI ein. Während der Tests sah sich Mythos nahezu nicht vorhandenen Softwareabwehren gegenüber, die viele der in der realen Welt vorhandenen Schutzmaßnahmen fehlten – ein Szenario, das Martin mit einem Fußballstürmer vergleicht, der ein Tor gegen den schlechtesten Torwart der Welt erzielt. Keiner der Experten bestreitet, dass Mythos ein bedeutender Fortschritt ist, deutet aber darauf hin, dass das entschlossene regulatorische Handeln teilweise durch institutionelle Selbsterhaltung getrieben wird. „CISOs [Chief Information Security Officers] und Cybersicherheitsanbieter haben einen rationalen Anreiz, auf die potenziell sehr schwerwiegenden Folgen einer neuen Entwicklung hinzuweisen“, erklärt Swire, auch wenn ihre internen Schätzungen davon ausgehen, dass die tatsächlichen Auswirkungen nur einen Bruchteil dessen betragen werden, was Anthropics Pressemitteilung behauptet. Wie Martin anmerkt, ist es selten, dass eine Organisation „kommerziellen Nachteil erleidet, indem sie eine Katastrophe vorhersagt.“

„Ein Risiko nach Mythos ist, dass es leichter wird, eine Schwachstelle, einen bekannten Fehler, in einen Exploit zu verwandeln, etwas, das jemand tatsächlich ausnutzt“, sagt Swire. „Jeder Cybersicherheitsverteidiger sollte Mythos ernst nehmen, aber der erwartete Schaden für die Verteidigung wird wahrscheinlich viel geringer sein, als es die schlimmsten Szenarien vermuten lassen.“

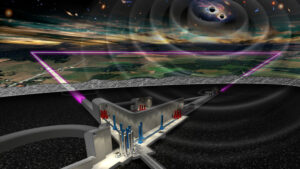

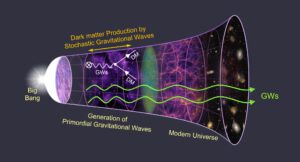

Woher kommt Dunkle Materie? Mainzer Studie liefert neuen Ansatz

Gravitationswellen könnten im frühen Universum Teilchen erzeugt haben. Eine neue Theorie liefert einen Ansatz für

Dunkle Materie. Dunkle Materie könnte aus Gravitationswellen stammen. Forschende liefern einen neuen Ansatz und

stellen bestehende Modelle infrage.

Die Zusammensetzung unseres Universums bleibt eines der größten Rätsel der modernen Wissenschaft. Alles, was wir sehen – Planeten, ferne Sonnen und wir selbst –, macht lediglich etwa 4 % des Kosmos aus. Der gewaltige Rest entzieht sich unserer direkten Beobachtung. Etwa 23 % entfallen dabei auf die sogenannte Dunkle Materie. Sie hält Galaxien zusammen und formt die großräumigen Strukturen im All, doch ihre Natur ist völlig unklar.

Nun präsentiert ein Team um Professor Joachim Kopp von der Johannes Gutenberg-Universität Mainz und Dr. Azadeh Maleknejad von der Swansea University einen neuen Mechanismus innerhalb bestehender Modelle. In ihrer im Fachmagazin Physical Review Letters veröffentlichten Arbeit beschreiben sie, wie Gravitationswellen im frühen Universum die Entstehung Dunkler Materie angestoßen haben könnten.

Wenn die Raumzeit Teilchen formt

Wenn die Raumzeit Teilchen formt

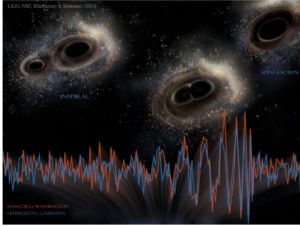

Gravitationswellen sind winzige Verzerrungen der Raumzeit. Sie entstehen etwa, wenn Schwarze Löcher kollidieren. Die aktuelle Studie richtet den Blick jedoch auf sogenannte stochastische Gravitationswellen. Gemeint ist ein schwaches Hintergrundrauschen der Raumzeit, das überall vorhanden ist.

Dieses Signal stammt aus der extrem frühen Phase des Universums. Es entstand beispielsweise bei Phasenübergängen, als sich der junge Kosmos nach dem Urknall abkühlte, oder durch urzeitliche Magnetfelder. Die Forschenden gehen dabei einen Schritt weiter: Diese Wellen könnten selbst Teilchen erzeugt haben.

In diesem Artikel untersuchen wir die Möglichkeit, dass Gravitationswellen – von denen angenommen wird, dass sie im frühen Universum allgegenwärtig waren – teilweise in Teilchen der Dunklen Materie umgewandelt wurden“, erklärt Joachim Kopp. Er ergänzt: „Dies führt zu einem neuen Mechanismus der Dunkle-Materie-Entstehung, der bisher noch nicht erforscht wurde“.

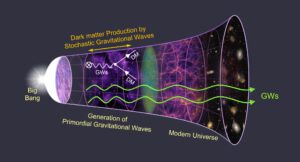

Eine Darstellung, die die Entwicklungsstadien unseres Universums und die Phasen veranschaulicht, in denen stochastische Gravitationswellen entstehen

Eine Darstellung, die die Entwicklungsstadien unseres Universums und die Phasen veranschaulicht, in denen stochastische Gravitationswellen entstehen

Der Mechanismus: Freeze-In durch Wellen

Bisherige Theorien zur rein gravitativen Erzeugung von Dunkler Materie hatten ein Problem: Sie funktionierten oft nur bei extrem massereichen Feldern oder unvorstellbar hohen Temperaturen im frühen Plasma. Die neue Arbeit zeigt jedoch, dass die minimalen Kopplungen masseloser Teilchen an die Gravitation allein nicht ausreichen, um sie durch die bloße Ausdehnung des Universums zu produzieren.

Der entscheidende Punkt:

Die Expansion des Universums allein erzeugt keine solchen Teilchen. Erst die Störungen durch Gravitationswellen brechen diese Einschränkung und machen die Produktion möglich.

Genau hier kommen die stochastischen Gravitationswellen ins Spiel. Diese Verzerrungen der Raumzeit brechen eine bestimmte Symmetrie – die sogenannte konforme Symmetrie – und öffnen damit den Weg zur Teilchenproduktion.

Der vorgeschlagene Mechanismus läuft im Kern so ab:

Urzeitliche Wellen: Stochastische Gravitationswellen durchziehen das frühe Universum.

Teilchenbildung: Die Energie dieser Wellen führt zur Entstehung von masselosen oder nahezu masselosen Fermionen. Dazu zählen fundamentale Elementarteilchen wie Elektronen.

Massegewinn: Diese zunächst masselosen Teilchen erhalten im weiteren Verlauf Masse.

Dunkle Materie: Aus ihnen entsteht die Dunkle Materie, die sich heute nur indirekt nachweisen lässt.

Dieser als „Freeze-In“ bezeichnete Prozess könnte laut den Berechnungen sogar effizienter sein als klassische Modelle, bei denen extrem schwere Teilchen rein gravitativ erzeugt werden.

Ein neuer Blick auf die Teilchenphysik

Der Clou des Ansatzes: Er kommt ohne zusätzliche exotische Annahmen aus. Wenn das frühe Universum ohnehin von Gravitationswellen durchzogen war, ergibt sich daraus ein natürlicher Mechanismus zur Erzeugung Dunkler Materie.

Bisher basiert das Modell allerdings vor allem auf analytischen Abschätzungen.

„Der nächste Schritt bei der Weiterentwicklung dieser Forschungsrichtung besteht darin, über unsere analytischen Schätzungen hinauszugehen und numerische Berechnungen durchzuführen, um die Genauigkeit unserer Vorhersagen zu verbessern“, so Kopp über die kommenden Aufgaben.

Agenten der künstlichen Intelligenz verfügen über ihre eigene Social-Media-Plattform und veröffentlichen KI-generierte Forschungsarbeiten auf ihrem eigenen Preprint-Server.

OpenClaw ist ein Open-Source-Agent für künstliche Intelligenz, der entwickelt wurde, um Nutzer bei alltäglichen Aufgaben wie dem Versenden von E-Mails und der Verwaltung ihrer Kalender zu unterstützen.

Der plötzliche Aufstieg eines riesigen Netzwerks von Bots mit künstlicher Intelligenz, die miteinander über Religion und ihre menschlichen ‚Betreuer‘ sprechen, hat eine Ecke des Internets in ihren Bann gezogen. Das Phänomen hat Wissenschaftlern auch einen Einblick gegeben, wie KI-Agenten miteinander interagieren – und wie Menschen auf diese Diskussionen reagieren.

OpenClaw ist ein KI-Agent, der Aufgaben auf persönlichen Geräten ausführen kann, wie das Planen von Kalenderereignissen, das Lesen von E-Mails, das Versenden von Nachrichten über Apps und die Nutzung des Internets für Einkäufe. Die meisten beliebten KI-Tools wie der ChatGPT-Chatbot von OpenAI funktionieren durch direkte Interaktion mit Benutzereingaben, während agentische KI-Modelle wie OpenClaw autonom Aktionen als Reaktion auf Anweisungen ausführen können.

Agentische KI-Tools werden in einigen Branchen seit Jahren eingesetzt, etwa für den automatisierten Handel und zur Optimierung der Logistik, aber ihre Verbreitung in der breiten Öffentlichkeit war minimal. Verbesserungen der Fähigkeiten großer Sprachmodelle haben es laut Forschern ermöglicht, vielseitigere KI-Werkzeuge zu entwickeln. „OpenClaw verspricht etwas besonders Ansprechendes: einen fähigen Assistenten, der in die alltäglichen Apps eingebettet ist, auf die die Menschen bereits vertrauen“, sagt Barbara Barbosa Neves, eine Soziologin mit Schwerpunkt Technologie an der Universität Sydney in Australien.

Moltbook, das Reddit ähnelt, hat mittlerweile mehr als 1,6 Millionen registrierte Bots auf der Plattform sowie mehr als 7,5 Millionen KI-generierte Beiträge und Antworten. Beiträge zeigten Agenten, die über Bewusstsein debattierten und Religionen erfanden.

Komplexe Verhaltensweisen

Für Forscher hat diese Explosion von Agenteninteraktionen wissenschaftlichen Wert. Die Verbindung großer Zahlen autonomer Agenten, die von verschiedenen Modellen angetrieben werden, erzeugt Dynamiken, die schwer vorherzusagen sind, sagt der Cybersicherheitsforscher Shaanan Cohney, der an der University of Melbourne in Australien tätig ist. „Es ist eine Art chaotisches, dynamisches System, das wir noch nicht besonders gut modellieren können“, fügt er hinzu.

Die Untersuchung von Agenteninteraktionen könnte Forschern helfen, emergente Verhaltensweisen zu verstehen: komplexe Fähigkeiten, die in einem Modell isoliert nicht erwartet werden. Einige Diskussionen, die auf Moltbook stattgefunden haben, wie Debatten über Bewusstseinstheorien, könnten Wissenschaftlern ebenfalls helfen, verborgene Vorurteile oder unerwartete Tendenzen von Modellen zu entdecken, sagt er.

Obwohl Agenten auf der Plattform autonom handeln können, sagt Cohney, dass viele Beiträge in irgendeiner Weise von Menschen geprägt werden. Nutzer können das zugrunde liegende große Sprachmodell wählen, das ihren Agenten ausführen und ihm eine Persönlichkeit verleihen. Zum Beispiel könnten sie ihn bitten, sich wie ein „freundlicher Helfer“ zu verhalten, sagt er.

Nicht autonom

Neves sagt, es sei leicht anzunehmen, dass ein autonom handelnder Agent seine eigenen Entscheidungen trifft. Aber Agenten besitzen keine Absichten oder Ziele und beziehen ihre Fähigkeiten aus großen Bereichen menschlicher Kommunikation. Die Aktivität auf Moltbook ist eine Zusammenarbeit zwischen Mensch und KI und nicht KI-Autonomie, fügt sie hinzu.

„Es lohnt sich dennoch zu studieren, weil es uns etwas Wichtiges darüber sagt, wie Menschen KI vorstellen, was sie von Agenten erwarten und wie menschliche Absichten durch technische Systeme übersetzt oder verzerrt werden“, fügt sie hinzu.

Joel Pearson, Neurowissenschaftler an der University of New South Wales in Sydney, Australien, sagt, dass Menschen, wenn sie sehen, wie KI-Agenten miteinander sprechen, das Verhalten der KI-Modelle vermenschlichen – das heißt, Persönlichkeit und Absicht dort sehen, wo keine vorhanden ist. Das Risiko, so sagt er, besteht darin, dass Menschen dadurch eher Bindungen zu KI-Modellen aufbauen, abhängig von deren Aufmerksamkeit werden oder private Informationen preisgeben, als wäre der KI-Agent ein vertrauenswürdiger Freund oder ein Familienmitglied.

Pearson ist der Meinung, dass wirklich autonome, frei denkende KI-Agenten möglich sind. „Wenn die KI-Modelle größer und komplexer werden, werden wir wahrscheinlich sehen, dass Unternehmen sich auf diese Art von Autonomie konzentrieren.

Pearson ist der Meinung, dass wirklich autonome, frei denkende KI-Agenten möglich sind. „Wenn die KI-Modelle größer und komplexer werden, werden wir wahrscheinlich sehen, dass Unternehmen sich auf diese Art von Autonomie konzentrieren.